Opgelet: virale foto in hoge resolutie van de schietpartij op een verpleger in Minnesota bevat AI-hallucinaties

- Gepubliceerd op 29 januari 2026 om 10:38

- Leestijd: 3 min

- Door: Gwen Roley, AFP Verenigde Staten

- Vertaling en aanpassing: Liesa PAUWELS, AFP Nederland

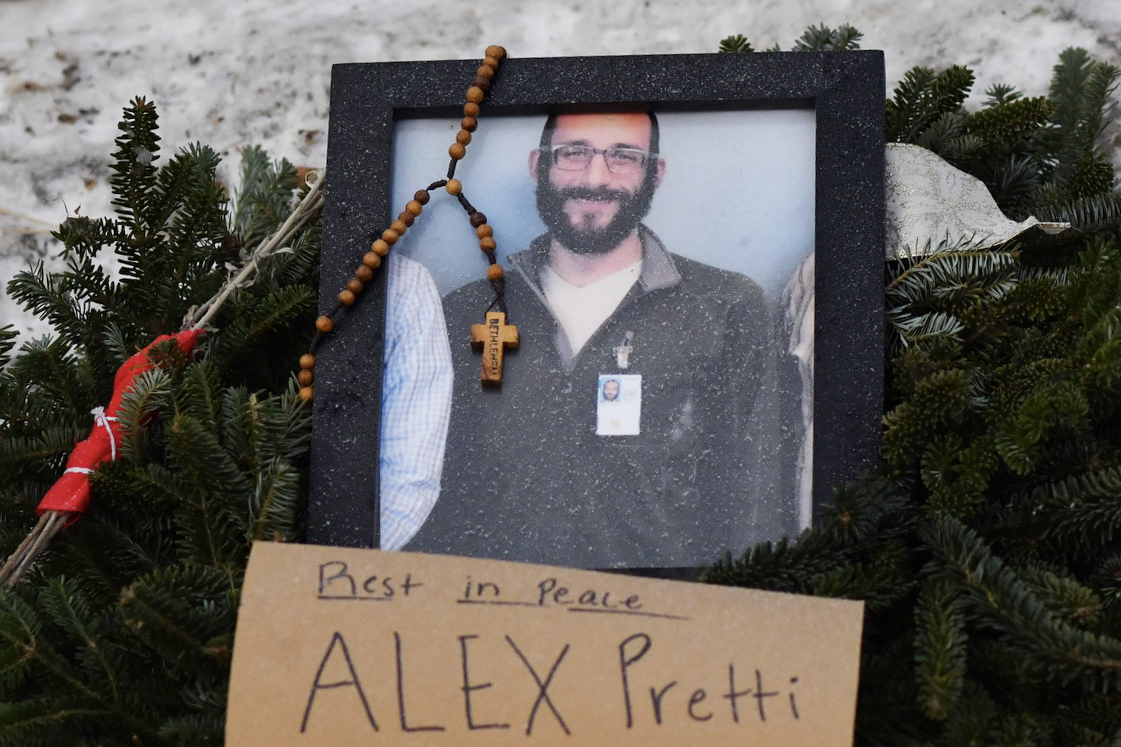

Op sociale media circuleren talrijke schokkende beelden van het moment waarop Amerikaanse immigratieagenten de 37-jarige intensive care-verpleegkundige Alex Pretti in Minneapolis, Minnesota, doodschoten. Eén van de beelden bleek echter gemanipuleerd te zijn met behulp van kunstmatige intelligentie. Deskundigen bevestigden dat het beeld een synthetische verbetering was van authentieke videobeelden van de schietpartij. Op de verbeterde foto heeft een van de agenten geen hoofd en lijkt het volgens sommige socialemediagebruikers alsof Pretti een wapen vasthoudt.

"De Trump-regering verliest rap vrienden na de dood van een tweede betoger in de stad Minneapolis", luidt het bijschrift van een bericht dat op 26 januari 2026 op Facebook werd geplaatst samen met de afbeelding in kwestie.

Op de afbeelding omsingelen agenten een man, vermoedelijk Pretti, die op de grond knielt, terwijl ze een pistool op zijn hoofd richten.

Gebruikers verspreidden de foto snel via Instagram, Facebook, X en Threads in het Engels en in het Nederlands. De hoge kwaliteit ervan stond in contrast met sommige van de korrelige beelden van het incident die al waren gedeeld.

Sommigen gebruikten de foto om kritiek te leveren op het gebruik van geweld door Amerikaanse agenten, terwijl het volgens anderen het bewijs was dat Pretti tijdens de confrontatie een wapen trok.

Waarschuwing

De spanningen in Minneapolis over de golf van immigratieagenten die door de Amerikaanse president Donald Trump naar de stad waren gestuurd, liepen op 24 januari opnieuw hoog op toen federale agenten Pretti, een Amerikaans staatsburger, neerschoten nadat ze hem op de grond hadden geworpen.

Het ministerie van Binnenlandse Veiligheid beweerde dat de verpleger van plan was agenten te verwonden, maar uit videobeelden die door Bellingcat en de New York Times werden geverifieerd, blijkt dat Pretti nooit het pistool heeft getrokken en dat hij op het moment dat hij werd neergeschoten kennelijk al ontwapend was.

Het incident volgt op een eerdere schietpartij van 7 januari waarbij een andere inwoner van Minneapolis, Renee Good, werd neergeschoten door een immigratie- en douaneagent. In tegenstelling tot wat bleek uit videobewijs, beweerde de regering-Trump dat ook Good het leven van agenten in gevaar bracht. AFP ontkrachtte verschillende misleidende beelden die naar verluidt verband hielden met het incident en het slachtoffer.

De vermeende foto in hoge resolutie van agenten die Pretti neerschieten is eveneens gemanipuleerd met behulp van kunstmatige intelligentie.

Een omgekeerde beeldzoekopdracht laat zien dat deze sterk lijkt op echte beelden die vanuit één hoek het incident tonen. Deze video werd geverifieerd door de New York Times, Bellingcat en anderen. De authentieke video is echter veel korreliger en van mindere kwaliteit.

Verschillende elementen van de foto in hoge resolutie zijn kenmerkend voor door AI gegenereerde beelden.

De agent die naast de figuur knielt die Pretti zou moeten voorstellen, lijkt geen hoofd te hebben. Een van de benen van de agent buigt in een onnatuurlijke hoek naast een onduidelijk object.

Het voorwerp in Pretti's rechterhand op de gemanipuleerde afbeelding, waarvan sommigen beweerden dat het een wapen was, is nog steeds wazig, maar authentieke beelden tonen aan dat hij aan die kant een telefoon vasthield.

Waarschuwing

Hany Farid, professor aan de School of Information van de Universiteit van Californië in Berkeley, vertelde aan AFP dat het GetReal Security-lab dat hij mede heeft opgericht, ook tot de conclusie kwam dat de afbeelding een AI-verbetering was van een echte videoframe. Hij legde ook uit dat dit type AI-generatie populair is geworden omdat gebruikers proberen duidelijke beelden te creëren op basis van originele video's van lage kwaliteit.

"Het probleem met deze beelden is dat de AI-verbetering de neiging heeft om details te hallucineren", zei hij in een e-mail op 26 januari 2026.

Hij wees op soortgelijke berichten waarin de agent die Good neerschoot synthetisch werd "ontmaskerd". AFP ontkrachtte eerder ook beelden waarbij kunstmatige intelligentie werd gebruikt om beveiligingsbeelden te "verbeteren" om de schutter van de conservatieve activist Charlie Kirk te identificeren.

Copyright © AFP 2017-2026. Voor commercieel gebruik van deze inhoud is een abonnement vereist. Klik hier voor meer informatie.

Heeft u content gezien die u door AFP wilt laten verifiëren?

Neem contact met ons op