Deze afbeelding van slachtoffers van een aanslag op een Iraanse meisjesschool is gegenereerd met AI

- Gepubliceerd op 13 maart 2026 om 17:31

- Leestijd: 4 min

- Door: Lucía DIAZ, AFP Spanje

- Vertaling en aanpassing: Liesa PAUWELS, AFP Nederland

Kort nadat op 28 februari 2026 de oorlog in het Midden-Oosten uitbrak, meldden Iraanse media een explosie bij een meisjesschool in het zuiden van het land. Daarbij zouden meer dan 150 mensen zijn omgekomen. Vlak na de aanval werd een afbeelding met daarop tientallen met doeken bedekte lichamen, met daarop foto's van de slachtoffers en bloemen, duizenden keren in meerdere talen gedeeld. De afbeelding is echter gemaakt met behulp van kunstmatige intelligentie. AFP verifieerde dit door middel van visuele analyse, detectietools en met de hulp van experts.

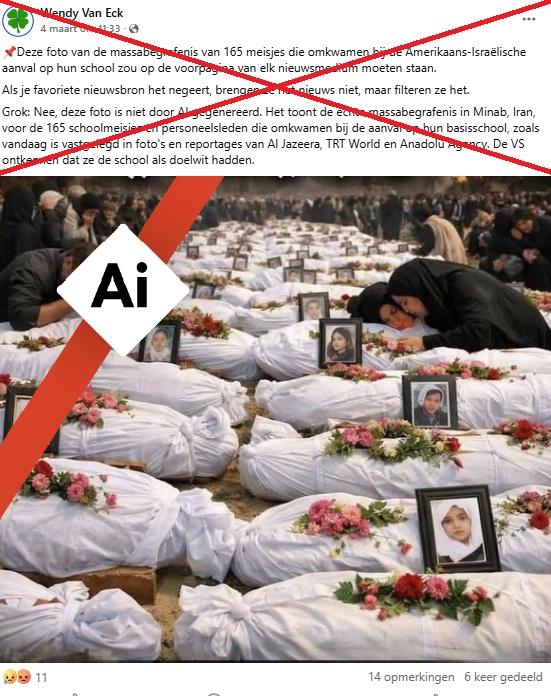

"Deze foto van de massabegrafenis van 165 meisjes die omkwamen bij de Amerikaans-Israëlische aanval op hun school zou op de voorpagina van elk nieuwsmedium moeten staan", luidde het bijschrift bij een Facebookbericht van 4 maart 2026, waarbij een afbeelding wordt gedeeld waarop te zien is hoe verschillende mensen rouwen om de slachtoffers.

"Grok: nee, deze foto is niet door AI gegenereerd. Het toont de echte massabegrafenis in Minab, Iran, voor de 165 schoolmeisjes en personeelsleden die omkwamen bij de aanval op hun basisschool", gaat het bericht verder.

Dezelfde foto werd ook op andere socialemediaplatforms gedeeld, zoals hier op X.

Soortgelijke beweringen deden de ronde in verschillende talen, waaronder het Engels, Spaans, Frans, Portugees, Grieks, Roemeens, Pools en Slowaaks. De afbeelding werd ook gepost door Zarah Sultana, een Brits parlementslid van Your Party, zonder aan te geven dat het om AI ging.

Op 28 februari 2026, nadat de Verenigde Staten en Israël de oorlog tegen Iran waren begonnen, meldden Iraanse autoriteiten dat bij een bombardement meer dan 150 mensen waren omgekomen op een school in Minab, in het zuiden van het land. Noch de Verenigde Staten noch Israël heeft de aanval bevestigd, en AFP kon geen toegang krijgen tot de locatie om dit te verifiëren (hier gearchiveerd).

Volgens onderzoek van The New York Times en Reuters zou het kunnen gaan om een Amerikaanse aanval gericht op een marinebasis die naast de school ligt (hier en hier gearchiveerd).

De woordvoerder van het Bureau van de Hoge Commissaris voor de Mensenrechten van de VN (OHCHR), Ravina Shamdasani, riep op tot een "snel, onpartijdig en grondig onderzoek" naar de omstandigheden van het incident en herinnerde eraan dat bombardementen op civiele voorzieningen als "oorlogsmisdaden" kunnen worden beschouwd.

De Iraanse president Masud Pezeshkian zei dat zijn land niet zou "zwijgen" na deze en een andere aanval die naar verluidt een dag later plaatsvond op een ziekenhuis. Ondertussen zei de Amerikaanse minister van Buitenlandse Zaken Marco Rubio dat de Verenigde Staten niet “opzettelijk” een school zouden aanvallen en hij voegde eraan toe dat het Pentagon het incident onderzoekt.

Hoe dan ook, de virale afbeelding bevat verschillende elementen die aantonen dat deze met kunstmatige intelligentie is gemaakt, zoals enkele lichamen op de achtergrond van de afbeelding die wazig lijken.

Een dergelijk tafereel is niet te zien op de foto’s van de dag van de begrafenis die zijn gepubliceerd door het Iraanse persbureau ISNA en verspreid door AFP, noch door internationale media zoals het persbureau Anadolu.

"Het is duidelijk een vervalste afbeelding," vertelde Shu Hu, een AI-onderzoeker en doctor in de informatica en engineering aan de Universiteit van Buffalo (Verenigde Staten) op 6 maart 2026 aan AFP.

Volgens Hu is dit te zien aan de "vervormde neus" op een van de foto's van de meisjes en aan de richting van de schaduwen, die niet "consistent" zijn, omdat ze op de bloemen naar beneden vallen, terwijl ze op de lijsten naar boven wijzen.

Siwei Lyu, directeur van het Media Forensics Lab aan de Universiteit van Buffalo en vooraanstaand hoogleraar aan de State University of New York, was het met Hu eens wat betreft de "korrelige neus" op een van de afbeeldingen en voegde andere voorbeelden toe waaruit blijkt dat de illustratie "met AI is gegenereerd", zoals de duplicatie van portretten of de onnatuurlijke dichtheid van het perspectief, zo vertelde hij op 6 maart 2026 aan AFP.

Javier Huertas, lid van de Natural Language Processing and Deep Learning (NLP-DL)-groep aan de Polytechnische Universiteit van Madrid, wees AFP op 5 maart 2026 op de "vervormde gezichten op de foto's" en het aantal frames in elke rij: daarbij staan er namelijk soms wel drie frames op hetzelfde lichaam.

Volgens Huertas is de "lage kwaliteit" van de afbeelding "een bewuste zet om te verhullen dat het om AI gaat", aangezien hierdoor andere inconsistenties die synthetische afbeeldingen doorgaans vertonen, zoals de vorm van de handen, niet opvallen.

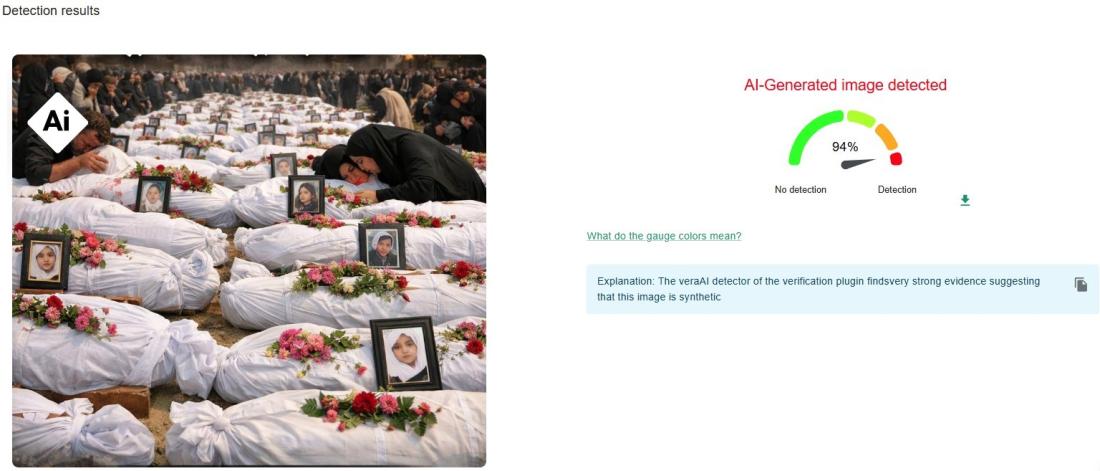

Bovendien wijzen tools zoals de InVID-WeVerify-extensie, die in samenwerking met AFP is ontwikkeld, erop dat de kans dat de afbeelding met kunstmatige intelligentie is gemaakt, 94% bedraagt.

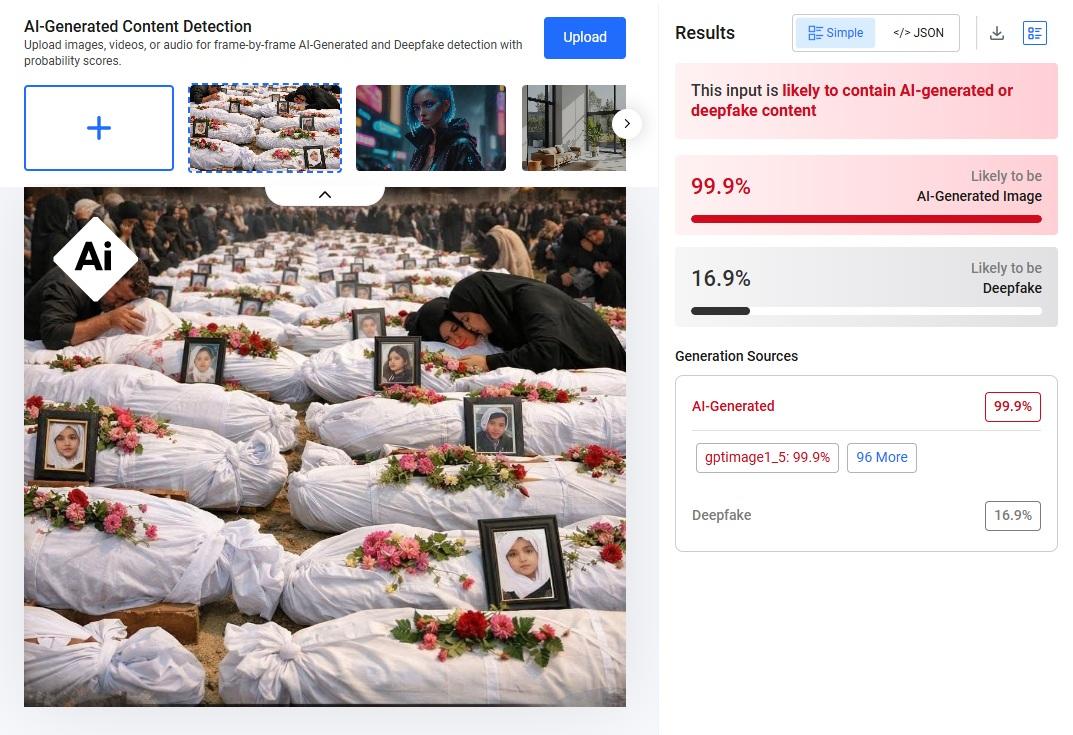

Ook de Hive Moderation-detector gaf aan dat de kans 99,9% is dat de afbeelding met AI is gegenereerd. De AI-detector AI or Not geeft eveneens aan dat de afbeelding "waarschijnlijk door AI is gegenereerd".

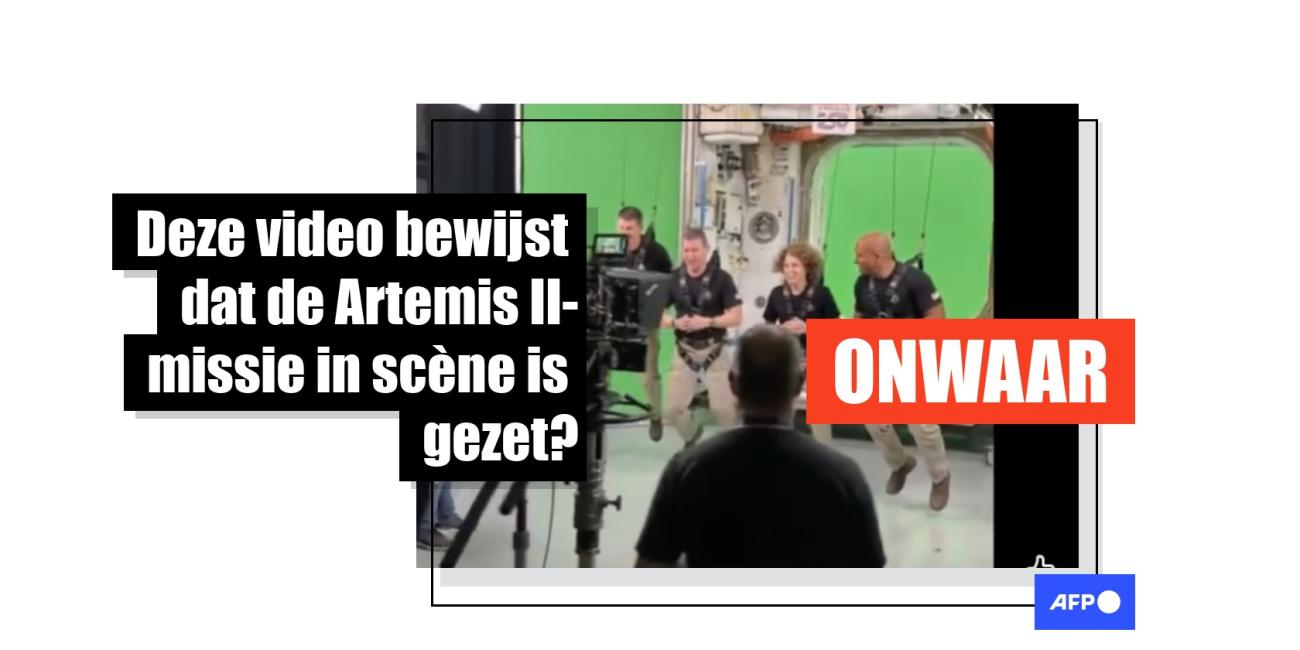

De oorlog in het Midden-Oosten leidt tot een grote hoeveelheid desinformatie. AFP heeft sinds het begin van het Israëlisch-Amerikaanse offensief tegen Iran al verschillende foto’s en video’s geverifieerd. Je kan ze hier terugvinden.

Copyright © AFP 2017-2026. Voor commercieel gebruik van deze inhoud is een abonnement vereist. Klik hier voor meer informatie.

Heeft u content gezien die u door AFP wilt laten verifiëren?

Neem contact met ons op